引言

YOLOV1、YOLOV2和YOLOV3都是Joseph Redmon大神的杰作,YOLOV3也是Joseph Redmon的最后一部作品,虽然最近两年又陆续出现了YOLOV4、YOLOV5等算法,但YOLOV3由于其通用性和高效率仍然是业内最为广泛使用的算法,下面就一起看看这篇论文吧!

YOLOV3

网络结构

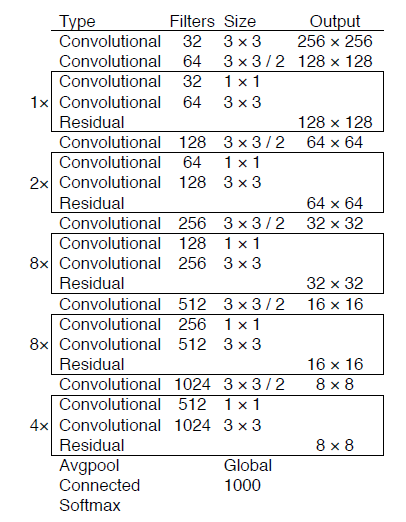

如下图所示是YOLOV3的网络结构,从图中可以看到每一层的输出大小:

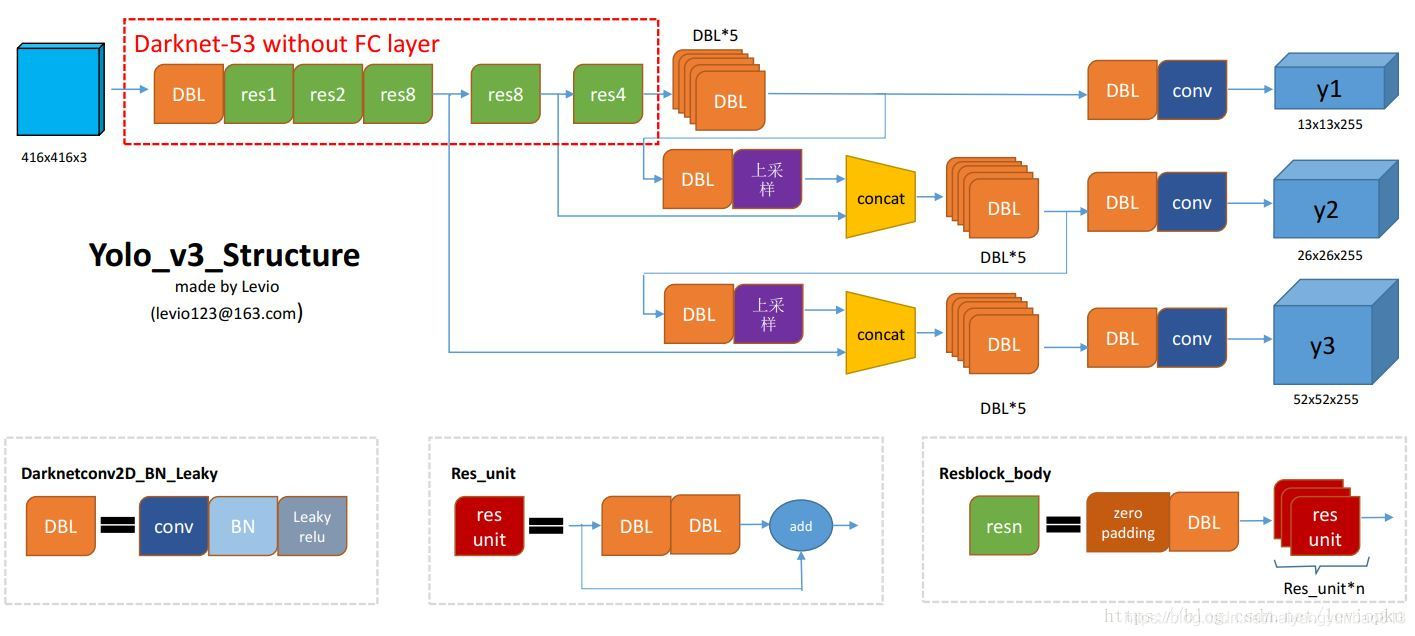

网络结构从YOLOV2的darknet-19改进到darknet-53,加深了网络层数,同时引入了Resnet中的残差连接操作,具体具体结构可以参照下图:

主要包含以下几个结构:

- DBL: 指的是conv、BN和leaky relu层的顺次连接

- res_unit:指的是原始输入和经过两个DBL后输出相加

- resn:指的是输入先经过零填充到指定大小后经过DBL再在几个维度上分别进行res_unit

YOLOV3的网络结构主要具有以下几种特点:

- Yolov3中,只有卷积层,通过调节卷积步长控制输出特征图的尺寸。所以对于输入图片尺寸没有特别限制。流程图中,输入图片以256*256作为样例

- Yolov3借鉴了金字塔特征图(FPN)思想,小尺寸特征图用于检测大尺寸物体,而大尺寸特征图检测小尺寸物体。特征图的输出维度为$N\times N\times [3\times (4+1+80)]$ , $N\times N$ 为输出特征图格点数,一共3个Anchor框,每个框有4维预测框数值$t_x,t_y,t_w,t_h$ ,1维预测框置信度,80维物体类别数。所以第一层特征图的输出维度为$8\times 8\times 255$

- Yolov3总共输出3个特征图,第一个特征图下采样32倍,第二个特征图下采样16倍,第三个下采样8倍。输入图像经过Darknet-53(无全连接层),再经过Yoloblock生成的特征图被当作两用,第一用为经过33卷积层、11卷积之后生成特征图一,第二用为经过1*1卷积层加上采样层,与Darnet-53网络的中间层输出结果进行拼接,产生特征图二。同样的循环之后产生特征图三

- concat操作与加和操作的区别:加和操作来源于ResNet思想,将输入的特征图,与输出特征图对应维度进行相加,即$y=f(x)+x$;而concat操作源于DenseNet网络的设计思路,将特征图按照通道维度直接进行拼接,例如$8816$的特征图与$8816$的特征图拼接后生成8832的特征图

- 上采样层(upsample):作用是将小尺寸特征图通过插值等方法,生成大尺寸图像。例如使用最近邻插值算法,将88的图像变换为1616。上采样层不改变特征图的通道数

YOLOV3借鉴了FPN、ResNet、DenseNet中的思想,所以效果才会那么显著

Loss和Train Strategy

Train Strategy

- 预测框一共分为三种情况:正例(positive)、负例(negative)、忽略样例(ignore)

- 正例:任取一个ground truth,与4032个框全部计算IOU,IOU最大的预测框,即为正例。并且一个预测框,只能分配给一个ground truth。例如第一个ground truth已经匹配了一个正例检测框,那么下一个ground truth,就在余下的4031个检测框中,寻找IOU最大的检测框作为正例。ground truth的先后顺序可忽略。正例产生置信度loss、检测框loss、类别loss。预测框为对应的ground truth box标签(需要反向编码,使用真实的x、y、w、h计算出 [公式] );类别标签对应类别为1,其余为0;置信度标签为1

- 忽略样例:正例除外,与任意一个ground truth的IOU大于阈值(论文中使用0.5),则为忽略样例。忽略样例不产生任何loss

- 负例:正例除外(与ground truth计算后IOU最大的检测框,但是IOU小于阈值,仍为正例),与全部ground truth的IOU都小于阈值(0.5),则为负例。负例只有置信度产生loss,置信度标签为0。

Loss Function

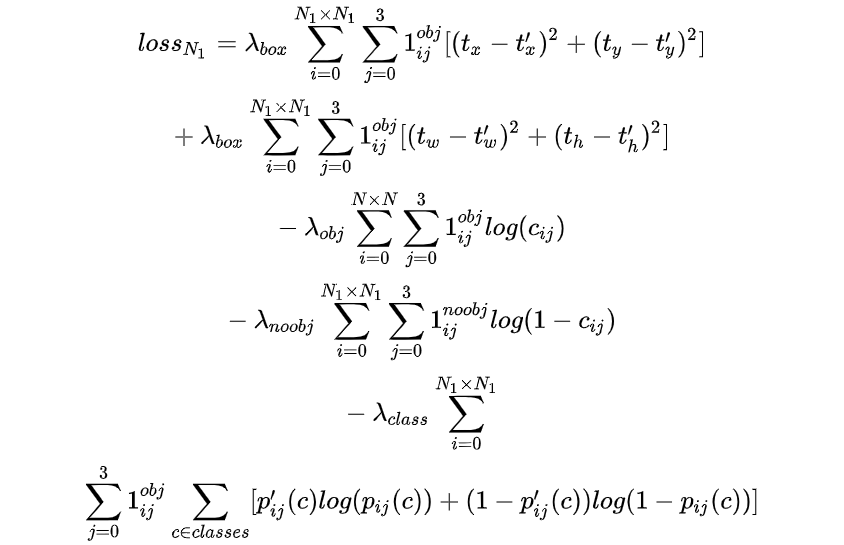

Yolov3 Loss为三个特征图Loss之和:

解释如下:

- λ为权重常数,控制检测框Loss、obj置信度Loss、noobj置信度Loss之间的比例,通常负例的个数是正例的几十倍以上,可以通过权重超参控制检测效果

- $1_$若是正例则输出1,否则为0;$1_$若是负例则输出1,否则为0;忽略样例都输出0

- x、y、w、h使用MSE作为损失函数,也可以使用smooth L1 loss(出自Faster R-CNN)作为损失函数。smooth L1可以使训练更加平滑。置信度、类别标签由于是0,1二分类,所以使用交叉熵作为损失函数。

小思考

- ground truth为什么不按照中心点分配对应的预测box?

在Yolov3的训练策略中,不再像Yolov1那样,每个cell负责中心落在该cell中的ground truth。原因是Yolov3一共产生3个特征图,3个特征图上的cell,中心是有重合的。训练时,可能最契合的是特征图1的第3个box,但是推理的时候特征图2的第1个box置信度最高。所以Yolov3的训练,不再按照ground truth中心点,严格分配指定cell,而是根据预测值寻找IOU最大的预测框作为正例 - Yolov1中的置信度标签,就是预测框与真实框的IOU,Yolov3为什么是1?

置信度意味着该预测框是或者不是一个真实物体,是一个二分类,所以标签是1、0更加合理 - 为什么有忽略样例?

忽略样例是Yolov3中的点睛之笔。由于Yolov3使用了多尺度特征图,不同尺度的特征图之间会有重合检测部分。比如有一个真实物体,在训练时被分配到的检测框是特征图1的第三个box,IOU达0.98,此时恰好特征图2的第一个box与该ground truth的IOU达0.95,也检测到了该ground truth,如果此时给其置信度强行打0的标签,网络学习效果会不理想

特征图解码

根据不同的输入尺寸,会得到不同大小的输出特征图,以图二中输入图片256 × 256 × 3为例,输出的特征图为8 × 8 × 255、16 × 16 × 255、32 × 32 × 255。在Yolov3的设计中,每个特征图的每个格子中,都配置3个不同的先验框,所以最后三个特征图,这里暂且reshape为8 × 8 × 3 × 85、16 × 16 × 3 × 85、32 × 32 × 3 × 85,这样更容易理解,在代码中也是reshape成这样之后更容易操作。

三张特征图就是整个Yolo输出的检测结果,检测框位置(4维)、检测置信度(1维)、类别(80维)都在其中,加起来正好是85维。特征图最后的维度85,代表的就是这些信息,而特征图其他维度N × N × 3,N × N代表了检测框的参考位置信息,3是3个不同尺度的先验框。下面详细描述怎么将检测信息解码出来:

- 先验框

在Yolov1中,网络直接回归检测框的宽、高,这样效果有限。所以在Yolov2中,改为了回归基于先验框的变化值,这样网络的学习难度降低,整体精度提升不小。Yolov3沿用了Yolov2中关于先验框的技巧,并且使用k-means对数据集中的标签框进行聚类,得到类别中心点的9个框,作为先验框。在COCO数据集中(原始图片全部resize为416 × 416),九个框分别是 (10×13),(16×30),(33×23),(30×61),(62×45),(59× 119), (116 × 90), (156 × 198),(373 × 326) ,顺序为w × h,先验框只与检测框的w、h有关,与x、y无关 - 检测框解码

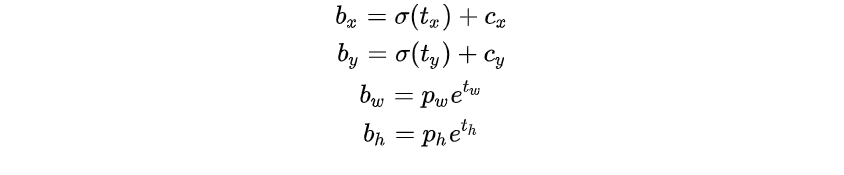

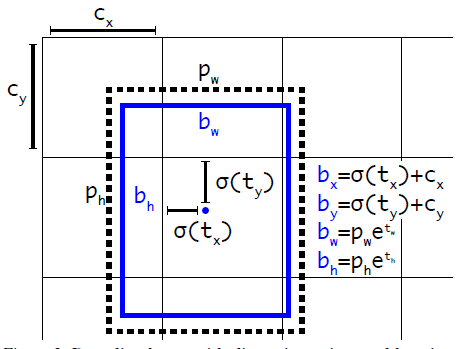

有了先验框与输出特征图,就可以解码检测框 x,y,w,h。

如下图所示, $\sigma(t_x),\sigma(t_y)$是基于矩形框中心点左上角格点坐标的偏移量, σ是激活函数,论文中作者使用sigmoid。 $p_w,p_h$是先验框的宽、高,通过上述公式,计算出实际预测框的宽高$b_w,b_h$,计算公式和YOLOV2类似,如下图所示:

- 检测置信度解码

置信度在输出85维中占固定一位,由sigmoid函数解码即可,解码之后数值区间在[0,1]中 - 类别解码

COCO数据集有80个类别,所以类别数在85维输出中占了80维,每一维独立代表一个类别的置信度。使用sigmoid激活函数替代了Yolov2中的softmax,取消了类别之间的互斥,可以使网络更加灵活。

三个特征图一共可以解码出 8 × 8 × 3 + 16 × 16 × 3 + 32 × 32 × 3 = 4032 个box以及相应的类别、置信度。这4032个box,在训练和推理时,使用方法不一样:

- 训练时4032个box全部送入打标签函数,进行后一步的标签以及损失函数的计算;

- 推理时,选取一个置信度阈值,过滤掉低阈值box,再经过nms(非极大值抑制),就可以输出整个网络的预测结果了